Come cambia la SEO con BERT: il più grande update di Google degli ultimi 5 anni

Il 25 ottobre Google ha annunciato la più recente e importante modifica agli algoritmi del suo motore di ricerca. Si chiama BERT, acronimo di Bidirectional Encoder Representations from Transformers, ed è in grado di interpretare molto meglio di prima le richieste degli utenti, restituendo risultati ancora più pertinenti.

Cos’è di preciso BERT?

BERT è un sistema nato per l’elaborazione del Natural Language Processing (NLP) che funziona attraverso una rete neurale artificiale, ovvero, un modello che imita il più possibile il funzionamento dei neuroni e il modo in cui comunicano e collaborano tra loro.

In buona sostanza, aiuta le macchine a comprendere il linguaggio in modo più simile a quanto fanno gli esseri umani.

In realtà, non si tratta di una vera e propria novità: BERT è un’evoluzione di Word2Vec, una rete neurale artificiale a due strati progettata come metodo di analisi testuale per elaborare il linguaggio naturale, già utilizzata (nonché creata) da Google.

L’aggiornamento è il risultato della ricerca di Google sui trasformatori: modelli che elaborano le parole in relazione a tutte le altre contenute in una frase. In questo modo viene considerato l'intero contesto di una parola, interpretando quelle che la precedono e la seguono, particolarmente utili per comprendere l'intento alla base di una chiave di ricerca.

“Se c’è una cosa che ho imparato negli ultimi 15 anni di lavoro in Google Search è che la curiosità delle persone è infinita” ha affermato Pandu Nayak, uno dei Responsabili di Google Search, “vediamo miliardi di ricerche ogni giorno e nel 15% dei casi si tratta di query nuove; per questo sviluppiamo sistemi per restituire risultati di ricerche che non siamo in grado di prevedere”.

Google afferma che il motore di ricerca riuscirà a interpretare il significato delle query più complesse, ovvero composte da frasi maggiormente articolate e con più sostantivi.

Il sistema si rivela molto utile anche per la Vocal Search: le ricerche vocali fatte con Google Assistant attraverso dispositivi Android e smart device.

Cosa cambia nelle ricerche degli utenti?

Applicando i modelli BERT sia al posizionamento dei link che ai featured snippet (risultati zero), Google è in grado di fornire risposte molto più pertinenti.

Questo perché l’algoritmo mette in relazione tra loro le parole, gestendole nel loro contesto e non più singolarmente come avveniva finora.

“BERT aiuta a comprendere meglio una ricerca su 10 negli Stati Uniti, in inglese, e nel tempo lo estenderemo a più lingue e più Paesi” ha affermato Nayak.

In breve: il cambiamento incide, al momento, sul 10% delle pagine dei risultati.

L’update, inoltre, riguarda per ora solo le ricerche in inglese ed è pensato soprattutto per le query più lunghe e più conversazionali, in cui una semplice preposizione è in grado di cambiare il senso della ricerca.

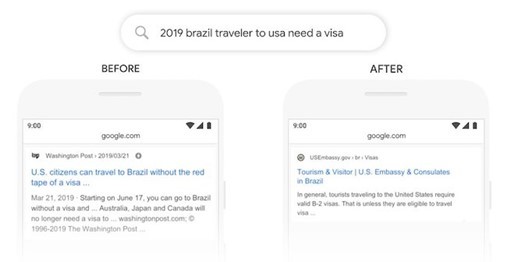

Come in questo caso:

Come mostra l’immagine, prima di BERT, la query “2019 brazil traveler to usa need a visa” (2019 brasiliano che viaggia verso gli stati uniti ha bisogno del visto) avrebbe restituito risultati diversi dall’intento di ricerca, perché l’algoritmo avrebbe analizzato ogni parola, individuando quelle più pertinenti e, sulla base di queste, avrebbe mostrato dei risultati.

La parola “to” (verso) sarebbe stata quindi sottovalutata, portando a mostrare siti che spiegano ai cittadini statunitensi se sia o meno necessario un visto per il Brasile.

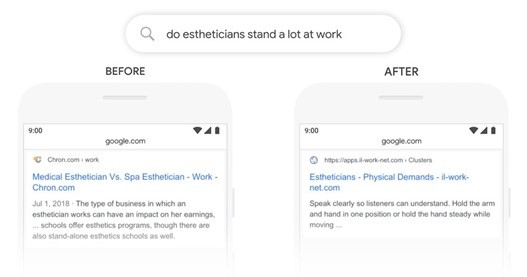

Diamo un'occhiata a un'altra query: “do estheticians stand a lot at work” (gli estetisti stanno molto tempo in piedi sul lavoro).

In precedenza, l’algoritmo avrebbe adottato un approccio di corrispondenza delle parole chiave, abbinando il termine "stand-alone" con la parola "stand", decontestualizzandola. I modelli BERT, invece, comprendono che "stare in piedi" è legato al concetto delle esigenze fisiche del lavoratore e mostra pertanto un risultato più attinente.

Cosa ne sarà di RankBrain?

RankBrain continuerà a fare il suo dovere. BERT infatti non sostituisce il precedente algoritmo; al contrario, lo potenzia.

L’algoritmo di Google è già in grado di interpretare il significato delle parole. Ad esempio, se ci sono refusi ci suggerisce la frase esatta che “forse” stiamo cercando, oppure individua sinonimi nei testi dei risultati che restituisce.

BERT è quindi un ulteriore aggiornamento, il più grande degli ultimi tempi a detta di Google stesso, che interpreta meglio contenuti e query fornendo risposte più pertinenti.

Come incide tutto questo sulla SEO?

La SEO non è morta, si è solo evoluta.

I continui aggiornamenti degli algoritmi di Google, di cui in larga parte non siamo nemmeno a conoscenza, ci dimostrano che per riuscire a creare contenuti ben indicizzati è doveroso tenersi al passo e adottare soluzioni tecnologiche.

In questo articolo abbiamo già approfondito il perché si dovrebbe parlare di SEO e Intelligenza Artificiale.

Impossibile ovviamente ricorrere agli stessi strumenti del motore di ricerca numero uno al mondo.

Come fare quindi?

In Wellnet abbiamo ideato un sistema che si avvicina ai modelli di ragionamento utilizzati da Google: attraverso uno studio approfondito degli algoritmi del motore di ricerca, e ricorrendo al Machine Learning e al Natural Learning Processing, siamo in grado di stabilire con un altissimo grado di accuratezza quale sarà il posizionamento dei contenuti all’interno delle SERP.

Il nostro approccio si muove su due binari paralleli: da un lato, analizziamo pagine e siti nel loro complesso e, dall’altro, studiamo le modalità con cui Google considera specifiche industries e determinati intenti di ricerca.

Su questa base, suggeriamo tutte le attività da implementare per far comparire i propri contenuti nei primi risultati di Google.