Mediaworld

Vocal Assistant App

Catena di distribuzione tedesca specializzata nell'elettronica e negli elettrodomestici di consumo. I punti vendita sono più di 110, collocati prevalentemente nei principali centri commerciali con una superficie media di vendita di 2.500 mq. Una leadership conquistata mantenendo inalterati nel tempo i principi di multicanalità, innovazione di valore e global community.

Sviluppare un’app sui principali Vocal Assistant per trovare il negozio più vicino e reperire le principali informazioni

La sfida

Il mercato delle applicazioni su Google Assistant e Amazon Alexa è ancora all’inizio. Google permette agli sviluppatori di terze parti di creare App specifiche appoggiandosi su tecnologie all’avanguardia nell’elaborazione del linguaggio naturale. Mediaworld ha scelto Wellnet per dotarsi di una propria applicazione su Google Home, Google Assistant e Amazon Echo (Alexa) che permettesse, attivando vocalmente l’action, di trovare il negozio più vicino e la lista dei negozi in una determinata città, di conoscere gli orari di apertura degli store e di trovare rapidamente un elenco dei prodotti in offerta e di quelli più venduti.

Mediaworld ha richiesto di creare un flusso di interazione con l’utente che fosse, al contempo, preciso sulle indicazioni e il più “umano” possibile nell’interazione.

Le soluzioni

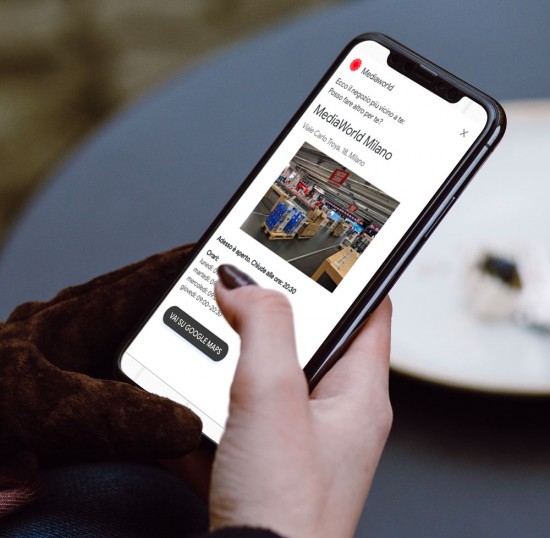

L’action che abbiamo creato, a cui si accede semplicemente chiedendo a Google Assistant o ad Alexa di “parlare con Mediaworld”, si collega con le API di Google Maps per trovare il negozio più vicino e i negozi situati in una determinata città e con le API di Google Places per trovare gli orari di apertura dei negozi e tutti i dati che vengono esposti nelle card di risposta.

Fase di progettazione delle interazioni (Natural Language Processing)

L’individuazione dei vari processi di interazione si è articolata in vari step:

- siamo partiti da uno studio del target e del corretto Tone Of Voice con cui comunicare;

- abbiamo individuato le possibili query di ricerca degli utenti e le keyword contenute in esse;

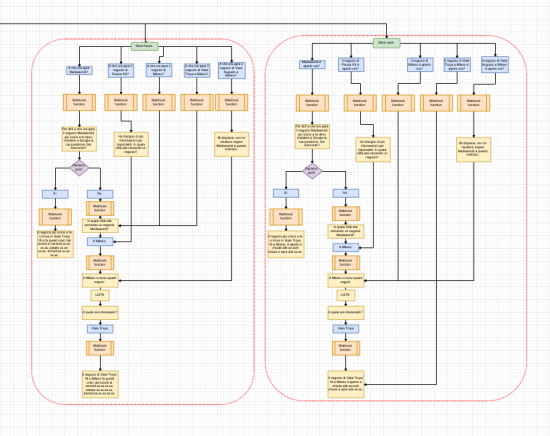

- sulla base delle richieste del cliente, abbiamo disegnato l’UX con i diversi flussi di conversazione tra utente e bot, in modo da includere tutte le possibili direzioni che la conversazione avrebbe potuto prendere;

- abbiamo testato i flussi per verificarne l’aderenza a reali conversazioni nei diversi contesti.

L’output di questo lavoro sono stati dei veri e propri diagrammi che ricalcano i processi di interazione tra utente e assistant. Da qui è iniziato il lavoro di sviluppo del bot.

Dettaglio Sviluppo

L’architettura si divide in tre componenti complementari, due delle quali fornite direttamente da Google.

La prima componente è Dialogflow , il vero “cervello” che garantisce l’interpretazione della richiesta dell’utente e la trasforma in dati strutturati.

La seconda componente è il “cuore” della App, che elabora i dati estratti da Dialogflow e fornisce risposte e soluzioni coerenti alle richieste dell’utente.

Lo sviluppo, è avvenuto su servizi cloud di Google, utilizzando il linguaggio di programmazione Golang che ha permesso una completa e corretta integrazione delle varie componenti, interfacciandosi con i vari servizi utilizzati (Dialogflow, Google Maps, Google Places, datastore Mediaworld).

Come in ogni progetto di valore, la terza e ultima componente consiste nella verifica e nel test end-to-end del sistema e dell’interazione con l’utente tramite Botium: una piattaforma con la quale abbiamo potuto effettuare i controlli necessari a garantire, sia durante lo sviluppo, sia al termine di ogni step produttivo, la qualità del prodotto.